J’ai été invité récemment à l’Université d’automne du syndicat CFE-CGC, qui s’intéressait cette année à la question des répercussions des nouvelles technologies sur le travail. On m’avait demandé de traiter le sujet suivant : « Big Data, Intelligence Artificielle : quels outils pour que l’entreprise conserve son humanité ? ». Je poste ci-dessous le texte de l’intervention, illustré par les diapos sur lesquelles je me suis appuyé.

1. Intelligence artificielle et « travail réellement humain » ?

Des innovations comme le big data ou l’intelligence artificielle posent sous un nouveau jour la question du rapport entre travail, humanité et déshumanisation.

Il est intéressant de ce point de vue de se replonger dans le préambule de la Constitution de l’OIT (Organisation Internationale du Travail), adoptée il y a un siècle en 1919. Ce texte intervient après la Première Guerre mondiale, alors qu’un déchaînement de violence sans précédent s’est produit du fait de l’emploi de moyens industriels qui ont permis la mort de masse (une « gestion industrielle du matériel humain » selon Alain Supiot). Les Nations éprouvent alors le besoin d’affirmer que la justice sociale est une composante essentielle à une paix universelle et durable. Et le texte contient en outre une notion, qui s’avère particulièrement intéressante à reconsidérer sous l’angle de l’Intelligence Artificielle : celle du « régime de travail réellement humain », que les États sont appelés à mettre en place et à garantir.

Cette expression a fait depuis l’objet de nombreux commentaires et un livre lui a encore été consacré à la rentrée, dirigé par Pierre Musso et Alain Supiot. Or la notion de « travail réellement humain » constitue une excellente porte d’entrée pour aborder la question de l’intelligence artificielle dans l’entreprise. Car cette nouvelle étape repousse les frontières de l’automatisation du travail. Celle-ci a d’abord concerné le travail manuel et des tâches intellectuelles « inférieures » pour gagner des fonctions « supérieures » qui paraissaient jusqu’alors constituer l’apanage des humains : la capacité à apprendre, la créativité, l’empathie, le pouvoir de prendre des décisions, au point même que l’on envisage sérieusement que des IA puissent rendre des décisions de justice ! Au regard de ces évolutions, quelle est la part qui va rester « réellement humaine » dans le travail ? Si l’on entend par un travail « réellement humain » des activités que seul l’homme est capable d’accomplir, sans doute pas grand chose… La capacité étendue de la machine à se substituer à l’homme pourrait à terme conduire à ce que la notion de « travail réellement humain » finisse par être vidée de tout contenu.

Il n’est pas certain qu’il faille s’en réjouir, car la notion de « travail réellement humain » portait aussi en elle l’espoir d’une possibilité de réalisation et d’une émancipation des hommes dans et par le travail, si souvent niée en théorie comme en pratique…

2. Travail et données : une longue histoire…

Pour fonctionner, les intelligences artificielles doivent d’appuyer sur des données massives : Big Data et IA sont les deux faces d’une même pièce. Or les liens entre travail et données ont une longue histoire qu’il est bon de garder en tête lorsque l’on réfléchit à ces questions.

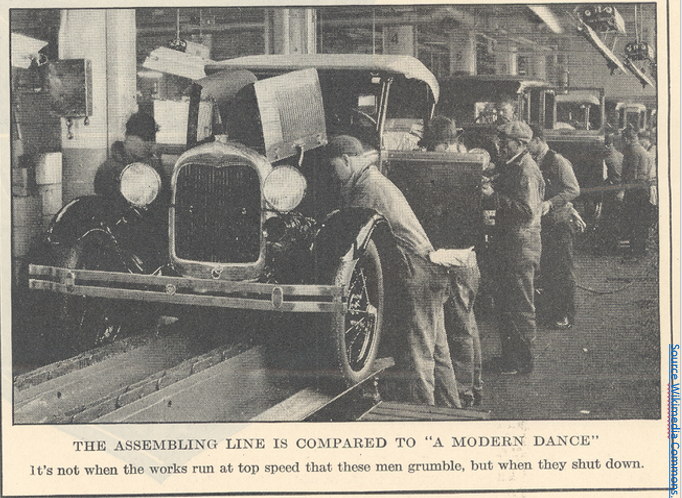

L’image ci-dessous montre une chaîne de montage dans une usine Ford durant l’entre-deux guerres. Elle a pour légende cette phrase : « Ce n’est pas lorsque la chaîne tourne à pleine vitesse que les ouvriers grognent, mais lorsqu’elle ralentit ». Et le journaliste de comparer l’activité des travailleurs à une « danse moderne »…

Or dès cette époque, l’organisation scientifique du travail qui se met en place avec le taylorisme repose sur une extraction de données réalisée à partir de l’activité des travailleurs. Cela se matérialisait notamment par le chronométrage des tâches effectuées par les ouvriers qui est au cœur de la méthode de Taylor. L’application de cette formule a suscité des résistances de la part des travailleurs qui vivaient le chronométrage comme une intrusion dans leur intimité et dans une sphère qu’ils estimaient devoir rester couverte par le « secret ». C’est ce qu’écrit la philosophe Simone Weil dans l’ouvrage « La condition ouvrière » en rapportant les propos d’un ouvrier soumis au taylorisme :

Les patrons ne comprennent pas que nous ne voulions pas nous laisser chronométrer ; pourtant, que diraient nos patrons si nous leur demandions de nous montrer leurs livres de comptabilité (…) ? La connaissance des temps de travail est pour nous exactement ce qu’est pour eux le secret industriel et commercial.

Dans les usines Ford, c’est une autre question liée à celle des données qui apparaît, avec le problème de la distinction entre le travail et la vie privée. C’est notamment ce que raconte Danièle Linhardt dans son ouvrage « La comédie humaine du travail. De la déshumanisation taylorienne à la sur-humanisation managériale ».

Pour tenir le coup lorsqu’ils travaillent à la chaîne, les ouvriers doivent littéralement mener une vie d’ascète. Henry Ford a créé un corps d’inspecteurs chargés d’aller vérifier qu’ils se nourrissent bien, qu’ils dorment correctement, qu’ils ne se dépensent pas inutilement, qu’ils ont un appartement bien aéré… Ford, qui était végétarien, propose même des menus à ses ouvriers. Il exerce une véritable intrusion dans la vie privée, officiellement pour le bien des salariés.

Aussi modernes qu’elles puissent paraître, les évolutions que sont le Big Data ou l’Intelligence Artificielle ne font donc que réactiver des problématiques très anciennes liées à l’organisation du travail en entreprise.

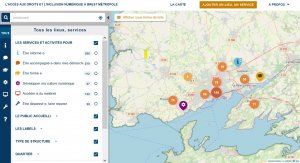

3) Apercevoir Le travail invisible des données

Dans son ouvrage « Le travail invisible des données », Jérôme Denis montre que le « travail des données » constitue même une réalité plus ancienne encore, puisqu’il existe en réalité depuis le 19ème siècle. cet auteur repère son apparition au moment où les organisations comme les entreprises et les administrations ont cru en taille et ont commencé à se bureaucratiser. Ce seraient les compagnies de chemin de fer aux États-Unis qui ont les premières éprouvé le besoin d’organiser un travail sur les données, parce qu’elles avaient un besoin vital de faire circuler des informations au sein de leurs structures en garantissant leur intégrité afin d’éviter les accidents. Pour cela, il a été nécessaire de mettre en place une standardisation et une rationalisation du travail intellectuel qui s’est déployée en parallèle de la taylorisation du travail manuel.

Jérôme Denis fait également le constat d’un paradoxe : ce « travail des données » joue un rôle important dans la vie des organisations, mais il y est le plus souvent aussi invisibilisé et dévalorisé. Cela découle d’une fausse image que nous nous faisons des données qui seraient dotées de la faculté « quasi-magique » de se propager toutes seules dans les organisations comme le long du système nerveux. Les métaphores que l’on emploie à leur égard (les données constitueraient un « gisement » ou une « mine d’or ») trahissent l’idée fausse que les données seraient « déjà là », indépendamment d’un travail humain. Or rien n’est plus faux, car les données nécessitent au contraire un laborieux, pénible et ingrat travail de production, de collecte, de gestion, de diffusion, d’archivage, etc. que la révolution informatique a davantage tendu à intensifier qu’à faire disparaître.

Ci-dessous un extrait du film Brazil, mettant en scène ce « travail des données » au sein d’un Ministère de l’information. Il constitue aussi une illustration frappantede la dévalorisation symbolique qui frappe ces tâches dans l’imaginaire collectif).

Or cette invisibilisation et cette dévalorisation du travail des données, qui existait depuis longtemps au sein des entreprises, on la retrouve aujourd’hui également sur Internet dans le rapport que les grandes plateformes entretiennent avec leurs utilisateurs :

D’innombrables entreprises, au premier rang desquelles celles que l’on rassemble un peu vite sous l’acronyme GAFA, misent aujourd’hui sur les algorithmes et les technologies de l’intelligence artificielle pour fournir des services innovants à leurs clients. Or (…) ces entreprises reposent sur des travailleuses et des travailleurs de la donnée aux tâches morcelées, mécanisées et très largement dépréciées.

4. Dans la Toile du Digital Labor

Sur Internet, ce travail des données prend la forme du « Digital Labor », notion dégagée par l’américain Trebor Scholtz et approfondie en France notamment par le sociologue Antonio Casilli. Ce vocable décrit la manière dont les grandes plateformes « mettent au travail » leurs utilisateurs, en leur faisant effectuer des tâches élémentaires (entrer des requêtes, liker, taguer ou partager des contenus, se géocaliser, remplir des profils, etc.) qui permettent de produire et de qualifier des informations exploitées ensuite par ces entreprises.

Ce travail des données peut prendre des formes plus ou moins invisibilisées. Sur la plateforme Amazon Mechanical Turk, le travail est certes « pulvérisé » à l’extrême, réduit à l’état de micro-tâches proposées aux internautes, mais il continue à faire l’objet d’une rémunération, quand bien même celle-ci est très faible. Mais on trouve des manifestations plus insidieuses du Digital Labor supprimant chez l’individu jusqu’à la conscience d’effectuer un acte productif.

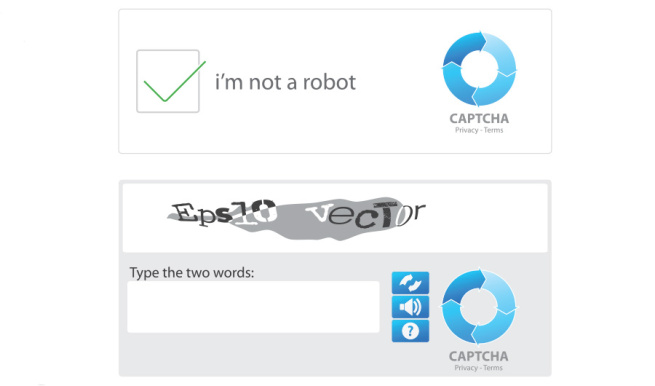

C’est le cas par exemple avec les « captcha », ce système de sécurisation permettant de vérifier si le visiteur d’un site est un humain et non un robot. C’est Google qui a mis au point ce dispositif et il le propose gratuitement aux autres gestionnaires de sites. Longtemps, l’étape d’identification consistait en des chaînes de caractères déformés que les individus devaient reconnaître pour entrer. Mais ce système a en réalité un « but caché » dans la mesure où il permettait de faire effectuer aux internautes la reconnaissance de caractères afin d’améliorer l’indexation des livres numérisées dans le cadre du projet Google Books.

Aujourd’hui, ces « captcha » ont changé et ils prennent parfois la forme de grilles de photographies provenant de Google Street View sur lesquelles les internautes doivent identifier des objets (arbres, voitures, maisons, etc.). Ces données sont ensuite utilisées pour entraîner ou « élever » des Intelligences Artificielles spécialisées dans la reconnaissance d’images, dont on a récemment appris que certaines seraient mises à la disposition de l’armée américaine pour équiper des drones de guerre (projet Maven). Il en résulte une vertigineuse perte de contrôle des individus sur l’usage des données qu’ils produisent. Le travail invisible s’effectue alors sans conscience d’en être un et sans connaissance des fins cachées qu’il sert…

5) Les nouveaux visages de la subordination

La manière dont les technologies sont mises en œuvre au sein des entreprises peut déjà conduire à des dérives dignes des pires épisodes de la série Black Mirror. On commence par exemple à voir apparaître en Chine des applications particulièrement inquiétantes, comme des casques enregistrant les émotions des salariés pour détecter leur état de fatigue, de stress, de concentration ou de bien-être, etc. Déjà testés dans plusieurs groupes chinois, ces procédés ont visiblement entraîné des réticences de la part des travailleurs, un peu comme le chronométrage des ouvriers avait provoqué lui aussi des résistances.

Mais dans cet article de Slate, on peut lire cette phrase particulièrement glaçante : « Ils pensaient que l’on voulait lire leurs pensées. Certains étaient mal à l’aise et il y a eu de la résistance au début. »

On peut voir là l’aboutissement caricatural de ce que Frédéric Lordon décrit comme la volonté d’aligner les désirs des employés sur ceux de l’entreprise en jouant directement sur leurs affects. Le travailleur devient ainsi complètement « transparent » avec ses émotions mises à nu, lui ôtant jusqu’à la faculté d’exercer une « objection de conscience » intérieure face à la subordination qu’il subit. Ce type de dérapages dans le déploiement des technologies n’est pas l’apanage de la Chine. Amazon a en effet déposé de son côté un brevet sur un bracelet ultrasonique destiné à « surveiller une performance relative à des tâches assignées« aux employés de ses entrepôts, pourtant déjà bourrés de caméras et de chronomètres. Ces machines sont par ailleurs des capteurs de données que les entreprises pourront analyser afin d’avoir une connaissance de plus en plus intime des travailleurs.

Pourtant, il faut garder à l’esprit que des technologies comme le Big Data ou l’Intelligence Artificielle peuvent aussi être utilisée pour le meilleur. Elles sont notamment un moyen d’alléger significativement la pénibilité dans certains secteurs, en déchargeant les humains d’une partie de ce travail des données dont nous avons vu qu’il est le plus souvent laborieux et ingrat, en plus d’être dévalorisé et peu reconnu.

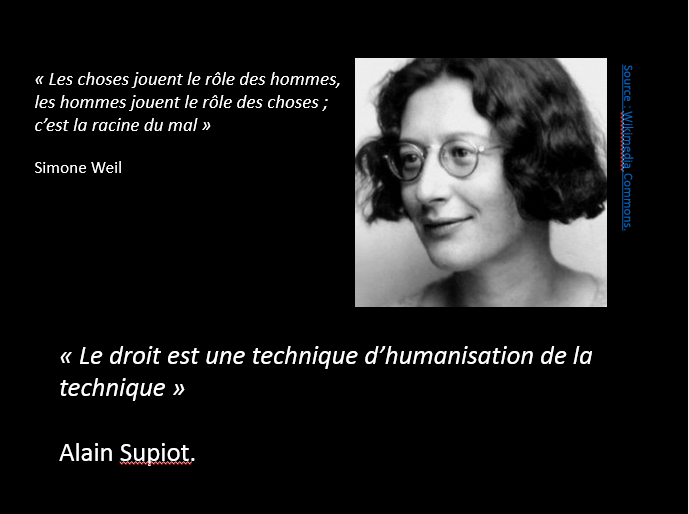

6) Le droit comme technique d’humanisation de la technique

« Le droit est une technique d’humanisation de la technique ». Cette phrase est issue de l’ouvrage de philosophie du droit Homo Juridicus écrit en 2009 par Alain Supiot, professeur au collège de France. Il y explore ce qu’il appelle la « fonction anthropologique du droit », c’est-à-dire le rôle que jouent le droit pour nous « instituer comme humains ». Il y consacre de longs développements aux rapports entre le droit et la technique, en faisant notamment remarquer que le droit du travail trouve son origine dans une fonction de protection des travailleurs vis-à-vis des risques induits par les machines industrielles, avec les premières législations sur les accidents du travail en 1898. Le droit s’est alors interposé entre les hommes et les machines pour préserver la dignité des premiers.

La philosophe Simone Weil, qui a fait volontairement l’expérience concrète du travail en atelier, avait remarqué qu’une inversion du rapport entre les hommes et les machines pouvait survenir dans les usines, avec de lourdes conséquences à la clé. Elle écrit notamment cette phrase : « les choses jouent le rôle des hommes, les hommes jouent le rôle des choses ; c’est la racine du mal ». Elle arrive à ce constat dans un passage du livre « La condition ouvrière », où elle remarque que les pièces détachées dans l’usine où elle travaille lui paraissent traitées plus dignement que les humains, parce qu’on leur reconnaît une forme « d’individualité » (elles sont soigneusement identifiées et étiquetées, comme si elles avaient une sorte « d’état civil »), alors qu’à l’inverse, les ouvriers y sont devenus des êtres anonymes et interchangeables que les patrons déplacent à leur guise sur les différents postes de la chaîne de production.

Une claire distinction entre les hommes et les choses serait donc une condition sine qua non pour préserver l’humanisation du travail. Mais des évolutions comme l’intelligence artificielle sont au contraire susceptibles de dramatiquement accentuer le brouillage potentiel des frontières entre les hommes et les choses. Nous en sommes déjà à un stade où la Californie a imposé par une loi que les assistants personnels et les chatbots se présentent explicitement comme des machines à leurs interlocuteurs humains, afin d’éviter les risques de confusion…

Dans un autre de ses ouvrages intitulé « La Gouvernance par les nombres », Alain Supiot fait l’histoire de ces confusions entre l’humain et les machines du point de vue de l’évolution du travail. Il explique qu’au temps du taylorisme, l’homme a d’abord été traité comme un mécanisme et inséré tel un engrenage vivant dans un agencement de machines. Avec l’avènement de l’informatique, on a ensuite cherché à le traiter comme un ordinateur programmable, à qui l’on fixe des objectifs chiffrés à atteindre en l’obligeant à se réajuster constamment par des boucles de rétroaction (gouvernance par les nombres, influencée par l’imaginaire cybernétique).

Mais l’intelligence artificielle va sans doute renverser les termes de cette confusion, puisque après avoir traité les humains comme des machines, c’est la machine qui risque à présent d’être traitée comme un humain, étant aujourd’hui en capacité de réaliser de plus en plus de tâches assimilées au « propre de l’homme ». Certaines voix s’élèvent d’ailleurs déjà pour réclamer que l’on accorde la personnalité juridique aux robots et aux intelligences artificielles, ce qui – outre de produire des effets pratiques très discutables en termes de responsabilité des responsabilités en cas d’incident – aurait sur le plan symbolique des effets désastreux en portant directement atteinte à la fonction anthropologique du droit.

7) Keep Calm and Comply With GDPR ?

Le RGPD (Règlement Général de Protection des Données) est un texte de droit qui a le potentiel de remplir cette fonction anthropologique en participant à l’humanisation du travail des données. Il s’appuie en effet sur l’inspiration humaniste de la loi Informatique & Libertés en protégeant les données personnelles, non comme une propriété, mais en tant qu’attribut de la personne humaine, au nom de la dignité qui est due à cette dernière.

Le texte s’articule autour d’un certain nombre de notions qui peuvent jouer un rôle dans le rééquilibrage de la relation aux technologies : limitation des finalités, principe de minimisation de la collecte des données, respects des droits de la personne, importance du libre consentement, protection « par défaut » des données personnelles, transparence et loyauté, etc.

Pour les technologies comme le Big Data ou l’Intelligence Artificielle, le RGPD peut même constituer un véritable défi, car les principes de minimisation et de limitation des finalités interdisent de collecter de grandes masses de données sans but préétabli et sans l’avoir déclaré à l’avance aux personnes concernées.

L’aggravation des sanctions et la mise en place du principe d’accountability, conjugué avec une meilleure opposabilité aux entreprises étrangères, offrent enfin des atouts sérieux, à condition que les individus s’en saisissent pour exprimer les potentialités du texte.

8) Du consentement individuel aux actions collectives

Issu d’un débat acharné au Parlement européen, le RGPD n’est cependant pas exempt d’un certain nombre de failles. L’un de ses défauts les plus criants est la conception individualiste sur laquelle il repose encore très largement, qui persiste à faire de l’individu isolé le centre de gravité de la protection des données personnelles. Cela se traduit notamment par la place accordée au « consentement libre et éclairé » dans le texte, qui peut autant paraître comme une de ses forces que comme sa plus grande faiblesse. Ce principe tend en effet à isoler les individus dans leur relation avec les grandes plateformes sur Internet en laissant entre leurs mains une faculté de choix qui peut facilement être retournée contre eux. Les GAFAM sont en effet passés maîtres dans l’art de « fabriquer du consentement » que ce soit par le biais du design de leurs interfaces (Dark Patterns, captologie) ou en exerçant des formes de « chantage au service », en imposant l’acceptation de leurs conditions d’utilisation en contrepartie de traitement de données (procédé pourtant illégal au regard du RGPD, mais encore largement répandu).

Faire reposer la protection des personnes sur leur consentement individuel est dès lors un pari risqué. Comme le dit Guillaume Desgens-Pasanau : « Il y a 40 ans, la loi informatique et libertés visait à protéger les individus contre le fichage abusif par les administrations et par les entreprises. Aujourd’hui, la question se pose différemment : comment protéger les utilisateurs contre eux-mêmes ? ». Heureusement le RGPD porte aussi en lui le potentiel d’un changement de paradigme vers une défense plus collective des données personnelles. Cela se manifeste notamment par la possibilité de lancer des actions de groupe pour faire valoir les droits de personnes lésées par des violations. L’association La Quadrature du Net a intenté des actions collectives de ce type contre les cinq GAFAM dès l’entrée en vigueur du RGPD afin de dénoncer des atteintes caractérisées au « consentement libre et éclairé » et 12 000 personnes lui ont donné mandat pour les représenter dans cette procédure.

Cette forme d’action collective n’est pas sans lien avec la manière dont les droits des travailleurs sont traditionnellement défendus au sein des entreprises.

9) La protection des données au travail comme enjeu de négociation collective

Vis-à-vis de la protection des données des employés, le RGPD va fonctionner d’une manière complètement différente. Le texte déconseille en effet de s’appuyer sur le consentement des personnes lorsqu’elles sont placées dans une relation de subordination. C’est le cas dans la relation salariale, en raison de l’asymétrie constitutive qui caractérise le rapport entre l’employeur et l’employé. Un consentement exprimé dans une telle situation ne saurait être dit « libre » et il serait dangereux de s’appuyer sur ce fondement dans les entreprises sous peine de faire participer les individus à l’affaiblissement de leurs propres droits.

A la place, les employeurs doivent s’appuyer pour les traitements de données de leurs salariés soit sur le fondement de l’exécution du contrat de travail, soit sur l’invocation d’un « intérêt légitime ». Cette dernière notion est cependant à manier avec prudence, car le RGPD précise que l’intérêt légitime ne peut être retenu si « les intérêts ou les libertés et droits fondamentaux de la personne prévalent compte tenu des attentes raisonnables des personnes concernées fondées sur leur relation avec le responsable de traitement ». Cela recoupe certains des principes classiques du droit du travail prévoyant déjà que les mesures restrictives de droits et de libertés au sein des entreprises ne doivent pas avoir de portée générale et rester proportionnées au but poursuivi.

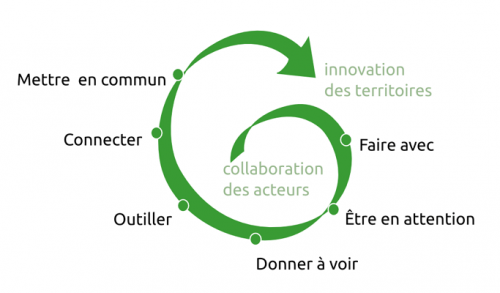

Par ailleurs, il n’y a pas de raison que « l’intérêt légitime de l’entreprise » soit défini de manière unilatérale par la direction. Un des enjeux à venir pour la démocratie sociale sera de faire de la délimitation de cet intérêt légitime un enjeu de négociation collective, en lien notamment avec le déploiement des nouvelles technologies comme l’intelligence artificielle.

De ce point de vue, la Charte Ethique RH élaborée par la CFE-CGC et le Lab RH constitue une première brique intéressante pour offrir un cadre à ces discussions collectives. Plus encore, l’article 88 du RGPD prévoit que les grands principes du texte puissent faire l’objet d’une déclinaison sectorielle par le biais des conventions collectives. Ce serait une excellente occasion de réactiver le principe de faveur et de redonner sens à la hiérarchie des normes, malmenés par les dernières réformes du droit du travail, en faisant en sorte que ces conventions collectives viennent fixer des garanties supplémentaires pour les droits des personnes par rapport au socle premier que constitue le RGPD.

10. Pour un droit social des données personnelles

Le droit peut donc être un instrument d’humanisation du travail des données. Peu importe à vrai dire que les machines puissent exercer de plus en plus de tâches qui paraissaient jusqu’alors le propre de l’homme. Car ce qui fait qu’un travail reste « réellement humain », ce n’est pas tant le maintien d’une séparation étanche entre les tâches exercées par les machines et les hommes que le fait que ces derniers continuent à être traités dignement comme des personnes capables d’avoir prise sur leur travail. L’intelligence « réellement humaine » restera aussi toujours l’intelligence collective qui peut s’exprimer dans les groupes au travail, à condition de laisser aux humains la possibilité de lier entre eux des rapports de reconnaissance réciproque.

Mais pour que le droit joue pleinement un rôle « anthropologique », il reste sans doute encore à « hybrider » le droit du travail et le droit à la protection des données personnelles pour faire émerger un « droit social des données ». Cela nécessite que les travailleurs s’organisent pour saisir l’opportunité offerte par le RGPD de faire de la maitrise des technologies en entreprise un enjeu de démocratie sociale. Les syndicats ont un rôle majeur à jouer dans ce processus, en impulsant le mouvement nécessaire à l’avènement de ce « droit social des données ».

Cette approche – qui comme le fait remarquer Olivier Ertzscheid reste encore largement à penser – peut jouer un rôle régulateur dans le déploiement de technologies comme le Big Data et l’Intelligence Artificielle dans les entreprises. Celles-ci peuvent même sans doute devenir les « incubateurs » d’une nouvelle conception de la protection des données personnelles, pensée d’emblée sous la forme d’une négociation collective. Une telle évolution est nécessaire pour la protection des travailleurs, mais au-delà pour l’ensemble de la société, car comme nous l’avons vu, chaque internaute est aujourd’hui un « travailleur de la donnée » engageant (ou perdant) une part de son humanité dans ses moindres gestes.